Essee teknohypestä ja ajatusten lukemisen etiikasta.

En ole koskaan halunnut pystyä ohjaamaan laitteitani ajatuksillani. Olen täysin iloinen voidessani käyttää fyysistä käyttöliittymää, jonka voin sammuttaa, josta voin päästää irti tai kävellä pois. Entä sinä? Pidätteleeko näppäimistösi sinua? Hidastaako hiiri sinua? Haluatko vain ajatella postausta ilman, että sinun tarvitsee peukaloida sitä? Miksi kyborgialaista teknologiaa painostetaan meille niin lujasti?

Onko kukaan pyytänyt sitä? Tarvitseeko kukaan sitä?

Tässä esseessä tarkastelen eettisiä tutkijoita, jotka herättävät huolta aivokäyttöliittymä (BMI – Brain Machine Interface) -teknologiasta, jonka ennustettu hyödyllisyys olisi kyky selata mieltäsi ja klikata aivoaaltojasi. Suoraan sanottuna en näe sille kysyntää, en edes halvaantuneille ihmisille, koska meillä on aivoleikkauksista vapaat rajapinnat, kuten Stephen Hawkingin käyttämät. Lisäksi haluammeko todella, että impulsiiviset raivotwiittimme lähetetään välittömästi?

Ei, ei, ei. Sinne tämä teknologia ei ole menossa. Kukaan ei halua BMI:n suorittavan tavallisia tehtäviä uudella tavalla, varsinkaan, jos se tarkoittaa oudon kypärän käyttämistä koko päivän tai aivoleikkauksen tekemistä. Porkkana ja keppi tässä on lupaus tehostetuista mentaalisista kyvyistä.

Näyttää olevan koordinoitu pelon lietsontakampanja, jolla vakuutetaan meidät siitä, että transhumanoidut tekoälykyborgilegioonat tulevat suoriutumaan meitä paremmin mentaalisesti. Joten kaikkien on hankittava BMI pysyäkseen mukana. Valitettavasti, kun teemme tämän, aivomme tulevat olemaan kaikkien oikean ohjelmiston omaavien luettavissa, emmekä pysty erottamaan omia päätöksiämme langattomien laitteiden kautta päähämme istutetuista päätöksistä.

Neuroeetikot ehdottavat, että meidän on toimittava nopeasti, ehkä jopa kirjoitettava perustuslakimme uudelleen!

Minusta heidän uusien neuro-oikeuksia koskevien ehdotustensa tarkoituksena ei ole suojella meitä niin paljon kuin rajoittaa tapoja, joilla meihin voidaan kajota suuremman edun vuoksi. Neuroeetikot ovat susia lampaan vaatteissa. Katsotaan oletko samaa mieltä arviostani.

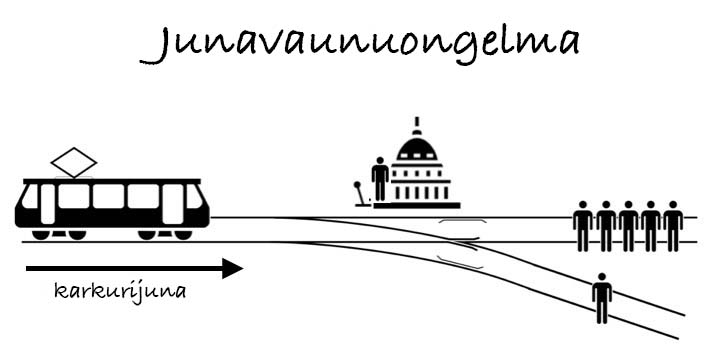

Laajemmassa kontekstissa tarkastellaan ensin niin sanottua ”junavaunun ongelmaa” etiikan alalla. Oletetaan, että mies käyttää vaihteistoa ratapihalla. Jos karannut junavaunu on etenemässä viiteen työntekijään radalla, onko hänen moraalinen velvollisuus vetää vipua ohjatakseen vaunu uudelleen siten, että se tappaa vain yhden työntekijän toisella radalla?

Saatat huomata, että olen tehnyt merkittävän muutoksen vakiokuvaan, tähän Wikipediasta nostettuun kuvaan, joka kuvaa tätä ongelmaa. Vaihtajani ei toimi oman edustuksensa alaisuudessa. Hän on hallituksen edustaja, joka toimii jonkin politiikan tai vakiomenettelyn mukaisesti. Siksi hän on kuvassa hallituksen rakennus takanaan. Tämä muutos muuttaa kaiken. Protokollan mukaan hänen on tapettava yksi mies pelastaakseen viisi.

Mutta, kun toimet ovat automatisoituja, edustusta ei ole, ja siksi miehen tekemistä ei voida kuvata valinnaksi toimia eettisesti. Vanhan ajan eetikot, esimerkiksi Akvinolainen tai Kant, väittivät, että moraali lähtee toiminnasta vapaasti päättävästä edustuksesta, mutta nykyään ajatus, että yksilöllä on vastuu (ei vapaus, ei oikeus, vaan vastuu) valita oikean ja väärän välillä on vain kadonnut eettisestä keskustelusta.

Jose Munoz on Mieli-Aivo -ryhmässä Espanjassa, hän on myös Harvardin Lääketieteellisessä ja muutamassa muussa todella tärkeässä paikassa. Tarkastellessaan kollegansa Nita Farahanyn työtä, hän tiivistää nykypäivän neuroeetikkojen lähestymistavan täydellisyyteen. Hän väittää, että meidän on ”vakiinnutettava suuntaviivat neuro-oikeuksille”. (Suuntaviivat, se kuulostaa lempeältä, mutta mietin, onko niillä sellainen voima kuin CDC:n ohjeistuksilla, jotka pantiin täytäntöön kaikella lainvoimalla).

Munoz sanoo, että on käytävä keskustelua tutkijoiden, hallitusten, yritysten ja yleisön välillä. (Mietin, kuka puhuu keskustelussa?) Hän sanoo, että ”kansalaisille” on taattava pääsy heidän dataansa. (Okei, minun täytyy hypätä muutaman vanteen läpi, jotta saan selville, mitä dataa minusta on kerätty tietämättäni tai ilman suostumustani, ja mitä sitten?)

Panen merkille sanan ”kansalaiset” käytön ihmisten sijaan.

Hän ei halua meidän unohtavan, että kansalaisina olemme valtion alamaisia. Hän uskoo myös, että ”tällaista dataa koskevaa lukutaitoa on kultivoitava”, mikä on räikeä tapa sanoa, että ihmisille on kerrottava, mitä heidän pitäisi ajatella datankeruusta. Milloin ihmisiä pyydettiin suostumaan datan keräämiseen? Mahdollisuus kieltäytyä datan keräämisestä ei kuulu tähän eettisten periaatteiden valikkoon.

Nykyään eettiset tutkijat näyttävät vain olettavan, että viime kädessä valtion on tehtävä nuo etiikkaa koskevat päätökset – konsensuksen pohjalta, tietysti. Joten se on okei, koska se on demokraattinen edustuksen menetys. Pian tekoäly optimoi nämä päätökset puolestamme, meille kerrotaan. Yksittäisestä ihmisestä on tullut pelkkä väline, jonka avulla jonkun toisen ”eettisiä” valintoja toteutetaan. Tämä ei ole eettistä. Tämä on vaarallista.

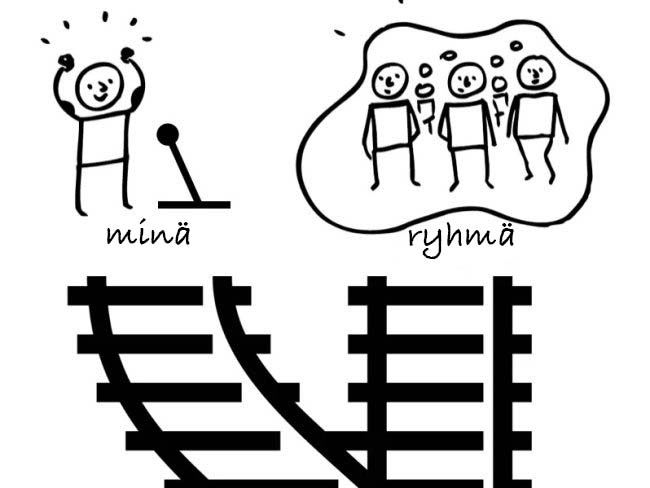

Voimme mukauttaa vaunuongelman kysymykseen, pitäisikö yksilön tehdä henkilökohtaisia uhrauksia yhteiskunnan hyväksi vai ei. Alla oleva kuva esittää sellaista logiikkaa, jonka mukaan ihmisten pitäisi vaarantaa henkensä sodassa maansa edun vuoksi tai ottaa rokote, johon liittyy jonkin verran riskiä, koska se on välttämätön lauman immuniteetille.

Tässä esseessä en väitä, että yksilöllä on oikeus olla itsekäs ja päättää olla tekemättä henkilökohtaisia uhrauksia muiden oletetun edun vuoksi. Se ei ole syy miksi meidän täytyy arvostaa yksilöllistä vastuuta yhteisen edun sijaan. Arvostamme yksilöllistä vastuuta, koska jos yksilöt painostetaan, pakotetaan tai lahjotaan uhraamaan yhteisen edun hyväksi, on olemassa vakava vaara, että taho, jolla on valta määrätä politiikkaa, voi käyttää tätä valtaa vahingoittaakseen, tahattomasti tai tahallaan.

Ainakin yksilöllisen vastuun myöntämisen myötä ongelmiin sovelletaan enemmän aivoja ja mahdollisuuksia löytää hyviä ratkaisuja. Haluammeko todella käydä sotaa? Ovatko rokotteet todella turvallisia ja tehokkaita? Lisäksi yksittäisen henkilön tekemät virheet rajoittuvat yleensä pieneen piiriin. Poliittisten päättäjien tekemät virheet vaikuttavat koko väestöön.

Kolme vuotta kestäneen painajaisen jälkeen, jossa ’Virheitä ei tehty’ – viitaten Margaret Anna Alicen runoon tällä otsikolla, jossa ”filantropaatteja” ja muita johtajia syytettiin tarkoituksellisesta demosidista – meidän pitäisi suhtautua skeptisesti kaikkiin ”eetikkoihin”, jotka vaativat meiltä lisää uhrauksia edistämään poliittisten päättäjien käsityksiä suuremmasta hyvästä. Mitä tulee COVlDiin, yksimielisyys on kehittymässä siitä, että he tekivät kaiken pieleen: sulkulukitukset, maskien käyttö ja eristäminen, varhaisen hoidon ja uudelleenkäyttöön tarkoitettujen lääkkeiden pidättäminen sekä kokeellisen rokotteen edistäminen.

Viime aikoina kuulemme melko paljon tarpeesta määritellä ihmisoikeudet uudelleen, kun yhteiskunnallinen maisema sopeutuu uusiin teknologioihin, jotka muuttavat ihmisenä olemisen merkitystä. Väitetään, että tarvitaan uutta ”Transhumanismin etiikkaa” pelastamaan meidät hakkereilta tai hallituksilta ja yrityksiltä, jotka saattavat haluta käyttää tekoälyä lukeakseen ajatuksiamme ja hallitakseen mieltämme.

Ienca ja Andorno, ’Towards a New Human Rights in the Age of Neuroscience and Neurotechnology – Kohti uusia ihmisoikeuksia neurotieteen ja neuroteknologian aikakaudella’ tutkimuksen kirjoittajat panevat merkille, kuinka paljon tietoa Internetin käyttäjistä kerätään nyt, ja he olettavat, että uusi teknologia kerää myös aivodataa. He pohtivat seuraavia eettisiä näkökohtia:

Mihin tarkoituksiin ja missä olosuhteissa aivoinformaatiota voidaan kerätä ja käyttää? Mitä aivoinformaation osia tulee laillisesti paljastaa ja tuoda muiden saataville? Kenellä on oikeus tutustua näihin tietoihin (työnantajat, vakuutusyhtiöt, valtio)? Mitkä pitäisi olla suostumuksen rajat tällä alalla?

He eivät edes mainitse selvempää väitettä, jonka mukaan kaikenlaista online-tiedonkeruuta voitaisiin pitää yksityisyyden loukkauksena. Kummallista kyllä, ensimmäinen oikeus, josta he keskustelevat tässä artikkelissa, on yksilöiden oikeus päättää käyttää uusia neuroteknologioita. Heidän keskusteluissaan oletetaan myös, että uudet teknologiat tekevät sen, mitä niillä mainostetaan tekevän. Ei keskustelua tarpeesta tehdä pitkäaikaisia tutkimuksia tai testata mahdollisia teknologiavirheitä. On muistettava, että COVID-rokotteen hätäkäyttölupa oli perusteltu, koska sanottiin, että ihmisillä pitäisi olla oikeus halutessaan käyttää testaamatonta teknologiaa.

Whitney Webb keskustellessaan neuro-oikeuksien painostamisesta Chilessä huomauttaa, että köyhät ja ääntä vailla olevat ohjataan BMI-tutkimuksen vapaaehtoisten etulinjaan.

Olen sitä mieltä, että aikuisten pitäisi voida vapaasti halutessaan osallistua uusiin, mahdollisesti vaarallisiin hoitoihin, hankkia DD-rintaimplantteja, tehdä itsemurha, käyttää heroiinia, työskennellä prostituoituna tai kastroida itsensä. Mutta en usko, että on eettistä kannustaa tai mahdollistaa ketään itsensä vahingoittamiseen. Eettinen yhteiskunta yrittää yleensä auttaa ihmisiä näkemään, että heillä voi olla muita vaihtoehtoja. Emme halua rohkaista ihmisiä ottamaan riskejä, emmekä todellakaan tarpeettomia.

Ienca ja Andorno kertovat meille myös, että…

Suurin osa ihmisoikeuksista, mukaan lukien yksityisyyden suojaa koskevat oikeudet, ovat suhteellisia siinä mielessä, että niitä voidaan rajoittaa tietyissä olosuhteissa edellyttäen, että jotkin rajoitukset ovat välttämättömiä ja ovat oikeasuhteinen tapa saavuttaa laillinen tarkoitus. Erityisesti yksityisyyden suojaa koskevassa Euroopan ihmisoikeussopimuksessa todetaan, että tämä oikeus sallii joitain rajoituksia ”levottomuuksien tai rikosten ehkäisemiseksi, terveyden tai moraalin suojelemiseksi tai muiden oikeuksien ja vapauksien suojelemiseksi.” (8 artiklan 2 kohta)

Tämä kuulostaa siltä, että eurooppalaisilla ei ole oikeuksia yksityisyyteen; heillä on etuoikeuksia, jotka voidaan peruuttaa milloin tahansa, kun valtio katsoo sen tarpeelliseksi.

Tiedetään hyvin, että jumaljonääri Elon Musk, hylkäämässä väitteensä libertarismia kohtaan, haluaa, että hallituksen määräykset tekoälystä, vaikka hän hypettää invasiivista Neuralink AI -teknologiaansa, istutetaan peruuttamattomasti ihmisen aivoihin, jotta niitä voidaan lukea. Toistaiseksi kädelliset testiyksilöt eivät ole menestyneet niin hyvin, ja syksyn 2022 Show & Tell oli äärimmäisen tyrmäävä. Yksi niistä monista ongelmista, joita heillä on ollut, oli se, että kädellisten aivoaaltokuviot tietylle kirjaimelle, jonka tekoäly oppi yhtenä päivänä, muuttuivat eri kuvioiksi viisi tai kuusi päivää myöhemmin.

Kauan sitten Herakleitos jo ymmärsi, ettemme koskaan astu samaan jokeen kahdesti. Kaikki biologiset prosessit ovat dynaamisia ja jatkuvasti muuttuvia, erityisesti muotoutuvat aivoaallot; niiden täytyy olla, koska maailma on myös. Elävien olentojen on jatkuvasti muututtava vain pysyäkseen enemmän tai vähemmän samana. Tietokonealgoritmit, eivät edes Deep Learning -algoritmit, ole niin muovailtavia kuin aivoaallot.

Tuon nolon Show & Tellin ajoista lähtien Neuralinkiltä on evätty lupa saalistaa ihmiskohteita, toistaiseksi. Mutta epäilen, estääkö tämä teknologiaan heitetty huono raha houkuttelemasta lisää hyvää rahaa. Sijoittajien on ansaittava pumpatut rahansa takaisin ennen kuin he dumppaavat. FDA tulee tolkkuihinsa.

En vastusta teknologista transhumanista kehitystä, joka auttaa ihmisiä voittamaan vaikeudet. Bioniset käsivarret ovat mahtavia, ja jopa raajojen uudistaminen kuulostaa hyvältä pyrkimyksen ajatukselta, huolellisesti. Mutta jokin ei ole oikein tässä keskustelussa BMI-teknologiasta ja neuro-oikeuksista.

Tänä vuonna Nita Farahany, itseään neuroeetikoksi kuvaileva oikeustieteen ja filosofian professori Duken yliopistosta, on mainostanut uutta kirjaansa, ’The Battle for Your Brain: Defending the Right to Think Freely in the Age of Neurotechnology’, joka ei puolusta mitään tuollaista. Tässä kirjassa hän ei anna ohjeita auttaakseen ihmisiä tekemään parhaita eettisiä päätöksiä itselleen ja perheelleen. Hän yrittää myydä eettisiä normeja pakotettavaksi meille kaikille.

Kirjassaan ja puheessaan Maailman talousfoorumin kokouksessa Davosissa Farahany esittää mielipiteitään kaksihaaraisella kielellä. Esimerkiksi, kun hän aluksi puolusti ajatusta mentaalisesta yksityisyydestä ja ”kognitiivisesta vapaudesta” (voi veljet, täytyykö heidän keksiä niin kiusallisia uusia termejä?), hän myöntää nopeasti, että se ei ole ehdoton oikeus – koska loppujen lopuksi yksi tärkeimmistä asioista, joita teemme ihmisinä, on yrittää ymmärtää, mitä kanssaihmisemme ajattelevat. Meidän on löydettävä tasapaino yksilöllisten ja yhteiskunnallisten etujen välillä, Farahany väittää. Tämä tarkoittaa, että päättäjät saavat päättää, mistä oikeuksista sinun on luovuttava.

Hän esimerkiksi sanoo, että saattaa olla hyvä idea saada kuorma-autoilijat käyttämään EEG-laitteita väsymyksen tarkkailemiseksi, yhteisen edun vuoksi. Jos he nukahtavat rattiin, he voivat tappaa viisi tai kuusi ihmistä. Voinko sen sijaan ehdottaa, että rekkamiehille maksetaan kohtuullisen hyvin heidän tekemästään työstä, jotta he eivät halua ajaa kahdeksaa tuntia pidempään päivässä? Vaihtoehtoisesti voimmeko saada poliittiset edustajamme alistumaan kaikkien sähköpostiensa ja puheluidensa ja jopa henkilökohtaisten keskustelujensa jatkuvaan valvontaan? Koska heidän päätöksensä voivat mahdollisesti tappaa miljoonia ihmisiä.

Farahany kehuu henkilökohtaisia laitteita, jotka tarkkailevat biologista dataa niiden mahdollisuudesta antaa työntekijöille kvantitatiivista dataa suorituskyvystään, jotta he voivat tehdä ”tietoisia itsensä parannuksia”. Se, että FitBits ovat niin suosittuja, hän väittää, osoittaa, että ihmiset ovat innostuneita siitä, että heitä seurataan ja pisteytetään. Mutta olen melko varma, että Amazonin varastotyöntekijät eivät vaadi neuropalaute-laitteita, jotka auttavat heitä olemaan kannattavampia osakkeenomistajille.

Pakkoseuranta ja tekaistu määrällinen arviointi on mielestäni epäeettistä.

Farahany myöntää, että tällaisen seurannan tulisi olla vapaaehtoista, ja uskoo, että työntekijät haluavat hyväksyä nämä laitteet itsensä kehittämiseen. Nykyään meillä on jotain samanlaista autovakuutuksen kanssa; ihmiset saavat alhaisemmat hinnat, jos he suostuvat valvotuiksi ajon aikana. Mutta, aina kun yksityisyyden uhraamisesta tarjotaan palkkio, se ei ole eettistä. Se on pakottavaa. Köyhät alistuvat todennäköisemmin kuin rikkaat.

Onko työntekijän suoritusten seurannasta edes hyötyä?

Kuten Yagmur Denizhan väittää esitelmässään ’Simulated Education and Illusive Technologies – Simuloitu koulutus ja kuvitteelliset teknologiat’, kun ihmiset joutuvat tilanteisiin, joissa heidät arvioidaan ansaittujen pisteiden perusteella – ei yleisemmän ja kokonaisvaltaisemman laadullisen arvioinnin perusteella – ovelat keskittyvät nopeasti järjestelmän pelaamiseen, jotta he voivat ansaita enemmän pisteitä vähemmällä vaivalla ja heikompi laatuisella työllä. Mutta Farahany ei koskaan kyseenalaista oletusta, jonka mukaan työntekijöiden saattaminen alttiiksi negatiivisen ja positiivisen palautteen antamiselle olisi hyväksi tuottavuudelle.

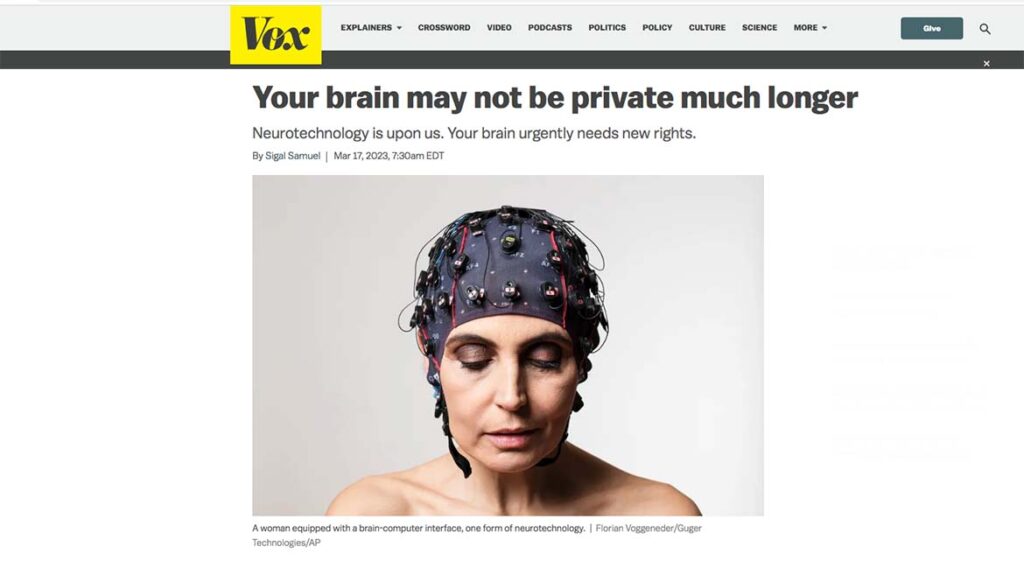

Samaan aikaan pelkoa lietsovaa propagandaa tulee jatkuvasti, sakeasti ja kovaa.

Katsoin tässä Vox-artikkelissa mainittua tutkimusta. Facebook-projekti on Kalifornian yliopistossa San Franciscossa. Tutkimus käsitti kolme osallistujaa, joiden aivoihin oli jo istutettu elektrodit osana valmistautumista neurokirurgiaan kouristuskohtausten hoitamiseksi.

Löytääkseen algoritminsa ihmisten ajatusten lukemiseksi, tutkijoiden oli koulutettava tekoälyä, minkä he pystyivät tekemään implantin ansiosta, joka antoi heille kuvan aivokuvioista. He esittivät potilaille kysymyksiä ja mallinsivat heidän vastauskaavojaan tekoälyn avulla. Tässä kokeessa ajatusten konteksti määriteltiin hyvin. Esimerkiksi koehenkilöiltä kysyttiin ”millainen huoneesi on?” ja heillä oli rajoitetusti vastauksia, kuten ”kylmä”, ”kuuma” tai ”hyvä”.

Luettuani näistä väitetyistä teknologisista ihmeistä, minusta näyttää siltä, että väite, että tämä uusi käyttöliittymä voisi ”poimia ajatuksia suoraan neuroneistasi ja kääntää ne sanoiksi”, on hieman liioittelua. Koehenkilöillä oli elektrodit päässään ja tekoälyn tarkkuus intensiivisellä, keskittyneellä harjoittelulla oli parhaimmillaan 60 %.

Puoli tusinaa neuroeetikkoa, joita luin valmistautuessani tähän esseeseen, mukaan lukien Farahany, väittävät, että jo on olemassa teknologioita, joilla on voimaa dekoodata ajatuksemme ja hallita niitä. Teknologiat, joita he mainitsevat esimerkkeinä, ovat EEG, fMRI ja syväaivostimulaatio. Seurasin heidän linkkejään kymmeniin tutkimuksiin ja luin sitten lainattuja tutkimuksia, ikään kuin olisin metsästämässä, ja olin yhä uudelleen ja uudelleen hämmentynyt todellisista tuloksista.

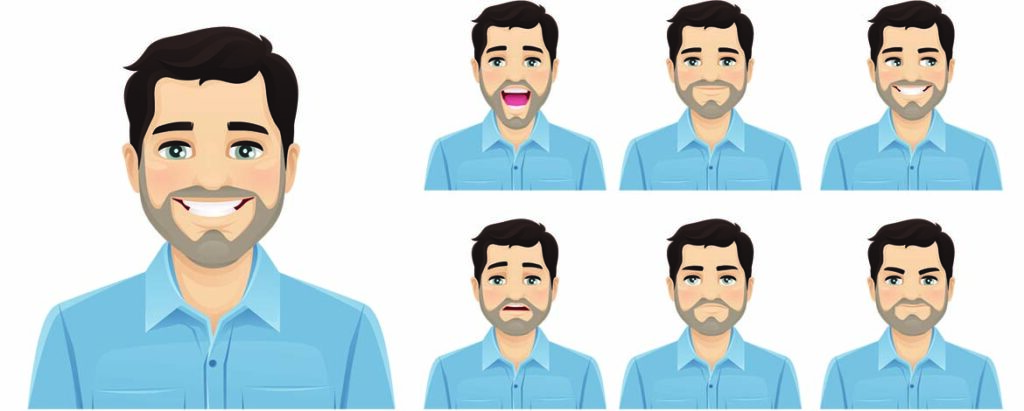

EEG-laitteella voit poimia kaavoja, jotka, jos ne dekoodataan, voivat antaa sinulle jonkinlaisen käsityksen kohteen tunnetilasta. Nappaatko gamma- vai alfa-aaltoja? Onko kohde keskittynyt vai unitilassa, ahdistunut tai rentoutunut?

Yllä mainitussa WEF-puheessaan Farahany antaa hyödyllisesti tämäntapaisen grafiikan eri kasvoista havainnollistaakseen erilaisia tunnetiloja, jotka EEG-laite saattaa havaita. Mikset vain katso kohteen kasvoista lukeaksesi hänen tunteitaan? Koska ihmiset, kuten Winston Smith, saattavat yrittää salata tunteitaan ja oligarkkimme eivät halua sitä?

EEG:t eivät lue ajatuksia. Tämä on hypeä, ehkä investointeja houkutellakseen. Tämä on vähiten kyyninen arvaukseni heidän motiiveistaan. Uskon, että T&K-osastot toivovat, että jos he voivat vain saada ihmiset käyttämään EEG-laitteita verkossa ollessaan ja myös kirjaamaan, millaisia tehtäviä he suorittavat, he voivat alkaa sovittaa tehtäviä EEG-kaavoihin tekoälyn avulla. Onnea sen kanssa. Ei-invasiivisena laitteena aivokuvanteen poimimiseen EEG ei anna hyvää dataa. Siitä ei vain voi päätellä paljoa.

Katsotaanpa fMRI:tä [functional Magnetic Resonance Imaging – toiminnallinen magneettikuvaus eli funktionaalinen magneettikuvaus]. Se on hyvin erikoistunutta koneistoa, jota löytyy vain sairaaloista, ja ylialtistumiseen liittyy joitain riskejä. Tällä hetkellä se on ainoa työkalu, joka voi tarkastella aivotoimintaasi 3D-muodossa (yksi mikroviipale kerrallaan) saadakseen käsityksen aivosi muodostamista malleista, kun ajattelet tiettyjä asioita tai suoritat tiettyjä tehtäviä.

Haynesin ynnä muiden vuonna 2007 tekemän tutkimuksen ’Reading Hidden Intentions in the Human Brain – Piilotettujen aikomusten lukeminen ihmisen aivoissa’ mukaan, jota neuroeettiset asiantuntijat ovat edelleen lainanneet, tutkijat laittoivat kahdeksan koehenkilöä fMRI-koneisiin ja kirjasivat muutokset aivokuvioissa, kun heille esitetään kaksi numeroa ja kehotetaan päättämään, lisätäänkö ne vai vähennetäänkö ne. Kun he päättivät, kumpi näistä kahdesta operaatiosta suoritettiin, tekoäly analysoi aivokuvioita, kunnes se havaitsi eron päätösten välillä. Tämän koulutusjakson jälkeen tutkijat testasivat tekoälymalliaan. He pystyivät kertomaan, mitä valintoja koehenkilöt olivat tehneet, olivatko he lisänneet vai vähentäneet, noin 20 % paremmalla tarkkuudella kuin satunnainen arvaus.

Huomaa, että tämä on tilanne, jossa kaikki muut mahdolliset ajatukset ja päätökset tukahdutettiin tarkoituksella ja koehenkilöt keskittyivät vain yhteen yksinkertaiseen valintaan. 20 % parempi kuin satunnainen ei tee vaikutusta minuun, varsinkin kun otetaan huomioon erittäin keinotekoiset olosuhteet. Koska meillä ei ole turvallista tapaa seurata ihmisten ajatuksia koko päivän harjoittaaksemme tekoälyä, ja useimmat meistä eivät vietä paljon aikaa fMRI-laitteissa, sanoisin, että olemme melko turvassa ajatusten lukemisen uhalta, ainakin tällä hetkellä.

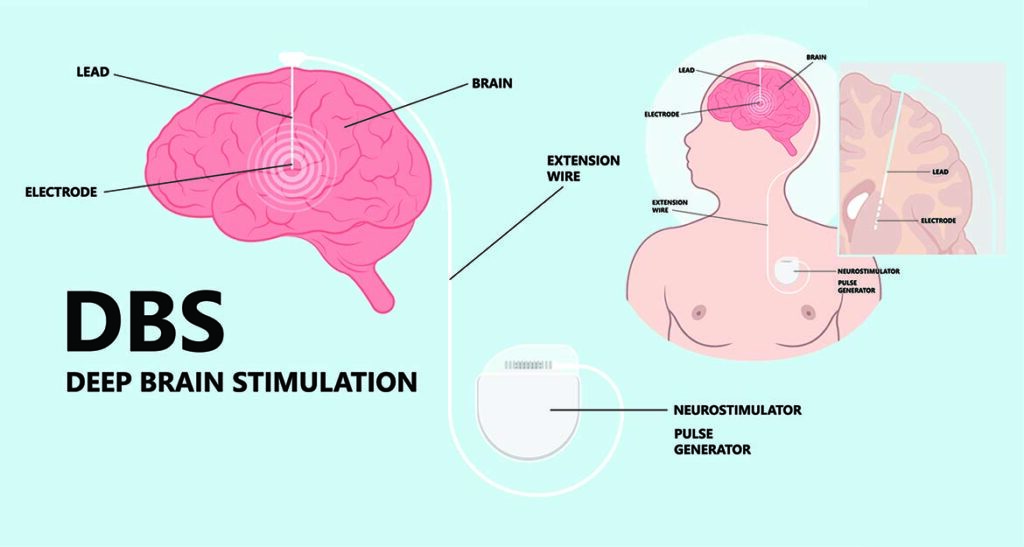

Katsotaanpa syväaivostimulaatiota (DBS – Deep Brain Stimulation).

DBS:ää käytetään pääasiassa motoristen sairauksien, kuten Parkinsonin taudin, hoitoon. Se lähettää sähköisiä impulsseja syvälle aivoihin, ja tutkijat yrittävät tehdä sen niin, että potilas voi muuttaa impulssien määrää ja aikaa. On olemassa viitteitä siitä, että siitä voi olla hyötyä. DBS:ää tutkitaan myös pakko-oireisen häiriön, masennuksen, riippuvuuden ja kivun hoitoon. Mutta, kuten Michael J. Fox Foundation for Parkinson -tutkimus varoittaa, DBS voi osittain lievittää joitain sairauksia, mutta sivuvaikutuksia ovat ajattelu- ja muistiongelmat.

Tämä laite käyttää uudelleen vanhaa sydämentahdistinteknologiaa. Yllä olevassa kuvassa oleva monitori on todella istutettu ihmisen kehoon. Kaapeli kulkee kaulan sisällä, ja elektrodi on kuin polyuretaanilla päällystetty naula, jolla on taipumus aiheuttaa tulehdusta. Lukiessani Nature Neurology -julkaisun 2020 katsauksen huomasin, että DBS:n tehokkuutta on vaikea arvioida. Elektrodin tarkka sijainti on ratkaiseva, mutta vaikea määrittää, ja vaikutusmekanismia, jos siitä on hyötyä, ei ymmärretä hyvin. Minusta ei vaikuta siltä, että tämän invasiivisen laitteen olisi pitänyt läpäistä bioetiikan arviointilautakuntaa.

Käsitykseni on, että tämä teknologia on pääasiassa tutkivaa ja kokeellista. Sen sovellusten laajentaminen vaikeaa Parkinsonin tautia sairastavien iäkkäiden ihmisten käyttöön ei vaikuta perustellulta. Tässä katsauksessa mitään näistä eettisistä huolenaiheista ei tuotu esille. He kuitenkin mainitsevat, että seuraavan sukupolven BDS-laitteita suunnitellaan WiFi-ohjattavaksi, jotta potilaat eivät tarvitse sitä kamalaa monitori-implanttia. Mutta tämä tekee potilaat alttiiksi ”aivokaappaukselle”, ja hakkerit voivat manipuloida tunnetiloja.

Toivotaan, että uutta langatonta DBS-muotoa ei sovelleta laajalti pelkän masennuksen tai OCD:n hoitoon.

Lopuksi totean, että ei näytä olevan totta, että olemme kehittämässä teknologiaa, jonka avulla ihmiset voivat lukea ajatuksiamme tai joka antaa tekoälylle mahdollisuuden hallita ajatuksiamme. Emme ole vielä siellä. Emme edes lähellä. Joten herää kysymys, miksi nämä eettiset asiantuntijat kampanjoivat uusien suuntaviivojen puolesta ei-olemattomille uhkille? Mikseivät he puhu yksilöiden suojelemisesta jo olemassa olevalta yksityisyyden menetyksen uhkalta verkossa?

Pelkään, että aivokäyttöliittymiä painostetaan samoista syistä kuin niistä, mitkä mahdollistivat kokeellisen rokotteen käyttöönoton. Tutkijat halusivat testata geeniterapiatekniikoita valtavalla populaatiolla viedäkseen alaa eteenpäin.

Samoin uskon, että yleisöä valmistellaan olemaan innokas testaamaan BMI:tä alan eteenpäin viemiseksi. Miten joku voi hyväksyä tällaisen suunnitelman? Vaikka olisi ihmiskunnan parhaaksi kiirehtiä eteenpäin transhumanistiseen tulevaisuuteen, haluammeko uhrata paljon yksilöitä ilman täyttä, tietoista suostumusta päästäksemme sinne?

Valitettavasti nykyään ”etiikka” määräytyy vaikutusvaltaisten toimesta ja pakotetaan kansalle. Entä jos yksilöllä olisi sen sijaan oikeus ja vastuu tehdä kaikki eettiset päätökset ja kärsiä seurauksista tai saada hyötyä? En ole esittänyt kovin montaa mielipidettä siitä, onko tämä tai tuo toiminta eettistä vai ei. Olen keskittynyt pääasiassa ajatukseen, että eettisiä päätöksiä siitä, mitä yksilöt ovat valmiita riskeeraamaan, ei tulisi koskaan pakottaa muiden, tärkeämpien ihmisten toimesta.

Itse asiassa olen alkanut kyseenalaistaa kaikki valtion virastojen niin sanotut ”säädökset”. Näyttää siltä, että kaikki eettiset ohjeet ja turvallisuusmääräykset ”suuremman edun vuoksi” saattavat olla vain tapoja laillistaa yksilölle mahdollisesti aiheutuva haitta harvojen eduksi.

Artikkelin on kirjoittanut VN Alexander ja se on julkaistu OffGuardian sivuilla 3.5.2023 sekä luvalla suomennettu ja julkaistu 21.5.2023 Rakkausplaneetan sivuilla. Julkaistu uudelleen 28.8.2025.

Alkuperäisen artikkelin löydät täältä:

off-guardian.org: Who Wants a Brain Machine Interface?